Hive查询

浅小兮基础语法及执行循序

https://cwiki.apache.org/confluence/display/Hive/LanguageManual+Select

-

查询语句语法

1 | SELECT [ALL | DISTINCT] select_expr, select_expr, ... |

-

书写次序和执行次序

| 顺序 | 书写次序 | 书写次序说明 | 执行次序 | 执行次序说明 |

|---|---|---|---|---|

| 1 | select | 查询 | from | 先执行表与表直接的关系 |

| 2 | from | 先执行表与表直接的关系 | on | |

| 3 | join on | join | ||

| 4 | where | where | 过滤 | |

| 5 | group by | 分组 | group by | 分组 |

| 6 | having | 分组后再过滤 | having | 分组后再过滤 |

| 7 | distribute by cluster by |

4个by | select | 查询 |

| 8 | sort by | distinct | 去重 | |

| 9 | order by | distribute by cluster by |

4个by | |

| 10 | limit | 限制输出的行数 | sort by | |

| 11 | union/union all | 合并 | order by | |

| 12 | limit | 限制输出的行数 | ||

| 13 | union/union all | 合并 |

基本查询(select … from …)

全表和特定列查询

数据准备

分别创建部门和员工外部表,并向表中导入数据。

-

在

/opt/module/hive/datas目录下编辑文件dept.txt,添加如下内容。

1 | [root@hadoop datas]$ vim dept.txt |

-

在/opt/module/hive/datas目录下编辑文件emp.txt,添加如下内容。

1 | [root@hadoop datas]$ vim emp.txt |

-

上传数据到HDFS

1 | hive (default)> dfs -mkdir /user/hive/warehouse/dept; |

-

建表语句,创建外部表

创建部门表 dept

1 | hive(default)> create external table if not exists dept( |

创建员工表

1 | hive(default)> create external table if not exists emp( |

全表查询

1 | hive (default)> select * from EMP; |

选择特定列查询

1 | hive (default)> select empno, ename from emp; |

注意:SQL 语言大小写不敏感;SQL 可以写在一行或者多行;关键字不能被缩写也不能分行;各子句一般要分行写;使用缩进提高语句的可读性。

列别名

-

列别名:为列指定一个别名

-

优点:便于计算

-

实现:紧跟列名,也可以在列名和别名之间加入关键词‘AS’

-

案例实操:查询员工名字和部门名称

1 | hive (default)> select |

算数运算符

| 运算符 | 描述 |

|---|---|

| A+B | A和B相加 |

| A-B | A减去B |

| A*B | A和B相乘 |

| A/B | A除以B |

| A%B | A对B取余 |

| A&B | A和B按位取与 |

| A | B |

| A^B | A和B按位取异或 |

| ~A | A按位取反 |

案例实操:查询出所有员工的总收入(薪水+奖金)显示。

1 | hive (default)> select ename, sal+comm income from emp; |

常用函数(set hive.exec.mode.local.auto=true;本地模式)

-

求emp表的总行数(count)

1 | hive (default)> select count(*) cnt from emp; |

-

求emp表中工资的最大值(max)

1 | hive (default)> select max(sal) max_sal from emp; |

-

求emp表中工资的最小值(min)

1 | hive (default)> select min(sal) min_sal from emp; |

-

求emp表中工资的总和(sum)

1 | hive (default)> select sum(sal) sum_sal from emp; |

-

求emp表中工资的平均值(avg)

1 | hive (default)> select avg(sal) avg_sal from emp; |

LIMIT 语句(limit 语句)

一般的查询会返回多行数据,在成产环境中,通常使用LIMIT子句用于限制返回的行数。

1 | hive (default)> select ename, sal from emp limit 5; |

WHERE 语句(where 语句)

-

使用WHERE子句,将不满足条件的行过滤掉

-

WHERE子句紧随FROM子句

-

案例实操:查询出薪水大于1000的所有员工

1 | hive (default)> select * from emp where sal > 1000; |

注意:where子句中不能使用字段别名。

比较运算符(Between/In/In Null)

下面表中描述了谓词操作符,这些操作符同样可以用于JOIN…ON和HAVING语句中。

(null与其他值比较或者运算得到的结果也是null)

| 操作符 | 支持的数据的类型 | 描述 |

|---|---|---|

| A=B | 基本数据类型 | 如果A等于B则返回TRUE,反之返回FALSE |

| A<=>B | 基本数据类型 | 如果A和B都为NULL,则返回TRUE,如果一边为NULL,返回False |

| A<>B, A!=B | 基本数据类型 | A或者B为NULL则返回NULL;如果A不等于B,则返回TRUE,反之返回FALSE |

| A<B | 基本数据类型 | A或者B为NULL,则返回NULL;如果A小于B,则返回TRUE,反之返回FALSE |

| A$ \leq $B | 基本数据类型 | A或者B为NULL,则返回NULL;如果A小于等于B,则返回TRUE,反之返回FALSE |

| A>B | 基本数据类型 | A或者B为NULL,则返回NULL;如果A大于B,则返回TRUE,反之返回FALSE |

| A$ \geq $B | 基本数据类型 | A或者B为NULL,则返回NULL;如果A大于等于B,则返回TRUE,反之返回FALSE |

| A [NOT] BETWEEN B AND C | 基本数据类型 | 如果A,B或者C任一为NULL,则结果为NULL。 如果A的值大于等于B而且小于或等于C,则结果为TRUE,反之为FALSE。 如果使用NOT关键字则可达到相反的效果。 |

| A IS NULL | 所有数据类型 | 如果A等于NULL,则返回TRUE,反之返回FALSE |

| A IS NOT NULL | 所有数据类型 | 如果A不等于NULL,则返回TRUE,反之返回FALSE |

| IN(数值1, 数值2) | 所有数据类型 | 使用 IN运算显示列表中的值 |

| A [NOT] LIKE B | STRING类型 | B是一个SQL下的简单正则表达式,也叫通配符模式, 如果A与其匹配的话,返回TRUE;反之返回FALSE。 B的表达式说明如下: ‘x%’表示A必须以字母‘x’开头,(%代表任意个数字符) ‘%x’表示A必须以字母’x’结尾,(_代表任一一个字符) ‘%x%’表示A包含有字母’x’,可以位于开头,结尾或者字符串中间。 如果使用NOT关键字则可达到相反的效果。(不支持正则) |

| A RLIKE B | STRING类型 | B是基于java的正则表达式,如果A与其匹配,则返回TRUE; 反之返回FALSE。 匹配使用的是JDK中的正则表达式接口实现的,因为正则也依据其中的规则。 例如,正则表达式必须和整个字符串A相匹配,而不是只需与其子字符串匹配。 |

案例实操:

1. 查询出薪水等于5000的所有员工

1 | hive (default)> select * from emp where sal =5000; |

2. 查询工资在500到1000的员工信息

1 | hive (default)> select * from emp where sal between 800 and 1100; |

3. 查询job为空的所有员工信息

1 | hive (default)> select * from emp where job is null; |

4. 查询工资是1500或5000的员工信息

1 | hive (default)> select * from emp where sal IN (1500, 5000); |

LIKE和RLIKE(like和rlike)

-

like关键词:使用LIKE运算选择类似的值

-

选择条件可以包含字符或数字:

% $ \rightarrow $ 代表零个或多个字符(任意个字符)。

_ $ \rightarrow $ 代表一个字符。

-

RLIKE关键字:RLIKE子句是Hive中这个功能的一个扩展,其可以通过Java的正则表达式这个更强大的 语言来指定匹配条件。

$x $ \rightarrow $ 代表以x结尾

^x $ \rightarrow $ 代表以x开头

.* $ \rightarrow $ 任意数量字符

. $ \rightarrow $ 一个任意字符

* $ \rightarrow $ 上一个字符可以无限次出现或者不出现

-

案例实操

- 查找名字以“小”开头的员工信息

1 | hive (default)> select * from emp where ename LIKE '小%'; |

2. 查找名字以“明”结尾的员工信息

1 | hive (default)> select * from emp where ename LIKE '%明'; |

3. 查找名字中带有“明”的员工信息

1 | hive (default)> select * from emp where ename LIKE '%明%'; |

逻辑运算符(AND/OR/NOT)

| 操作符 | 含义 |

|---|---|

| AND | 逻辑并 |

| OR | 逻辑或 |

| NOT | 逻辑否 |

案例操作:

1. 查询薪水大于1000,部门是30

1 | hive (default)> select * from emp where sal>1000 and deptno=30; |

2. 查询薪水大于1000,或者部门是30

1 | hive (default)> select * from emp where sal>1000 or deptno=30; |

3. 查询除了20部门和30部门以外的员工信息

1 | hive (default)> select * from emp where deptno not IN(30, 20); |

分组

GROUP BY 语句(group by 语句)

GROUP BY语句通常会和聚合函数一起使用,按照一个或者多个列队结果进行分组,然后对每个组执行聚合操作。

案例实操:

1. 计算emp表每个部门的平均工资

1 | hive (default)> select t.deptno, avg(t.sal) avg_sal from emp t group by t.deptno; |

2. 计算emp每个部门中每个岗位的最高薪水

1 | hive (default)> select t.deptno, t.job, max(t.sal) max_sal from emp t group by t.deptno, t.job; |

HAVING 语句(having 语句)

having与where不同点:

where后面不能写聚合函数,而having后面可以使用聚合函数。

having只用于group by分组统计语句。

案例实操:

1. 求每个部门的平均工资

1 | hive (default)> select deptno, avg(sal) from emp group by deptno; |

2. 求每个部门的平均薪水大于2000的部门

1 | hive (default)> select deptno, avg(sal) avg_sal from emp group by deptno having avg_sal > 2000; |

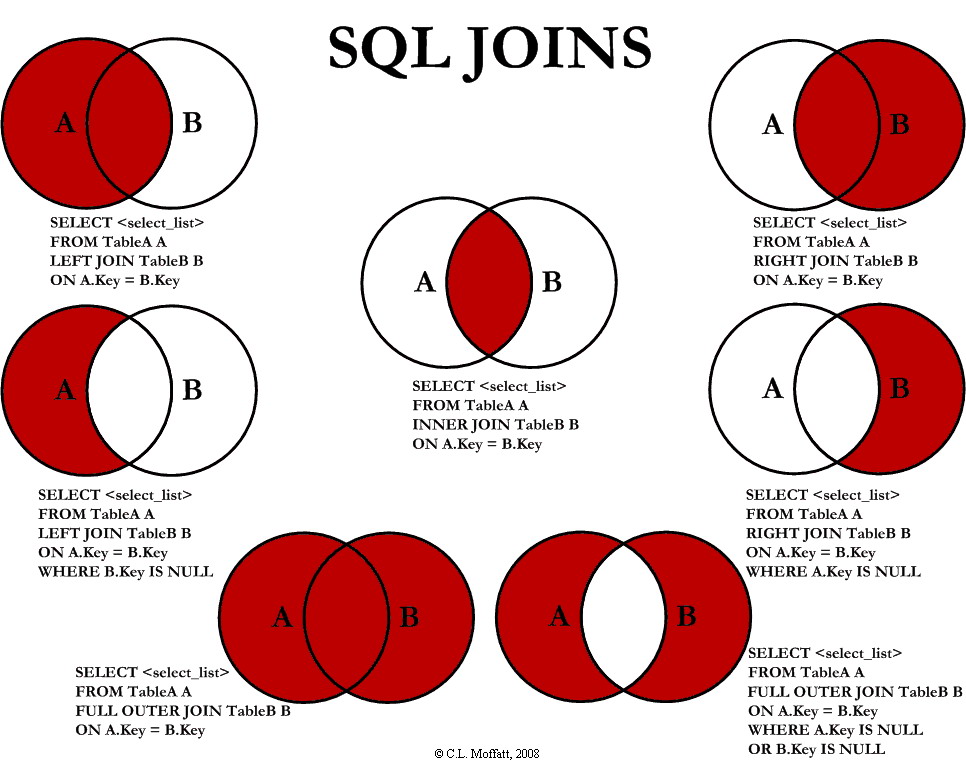

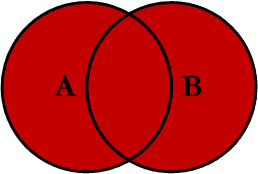

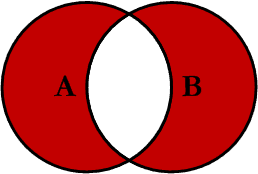

JOIN 语句

具体查看:Visual Representation of SQL Joins- CodeProject

数据准备:

(set mapreduce.job.reduces;

mapreduce.job.reduces=-1)默认是按照数据量来分配

为了体现学习上述所种join方式,现在需要为emp表和dept表添加特有数据

为emp表添加一条数据,员工编号1001,姓名fanfan等信息,但是部门编号设为50

1 | hive(defult)> insert into table emp values(1001, 'fanfan', 'sing',7839, '2021-08 |

等值 JOIN

Hive支持通常的SQL JOIN语句。

案例实操:根据dept表和emp表中的deptno相等,查询empno、deptno、ename和dname;

1 | hive(default)> select |

表的别名 AS

使用表的别名的好处

-

使用别名可以简化查询。

-

使用表的别名可以区分字段的来源。

案例实操:合并员工表和部门表

1 | hive (default)> select |

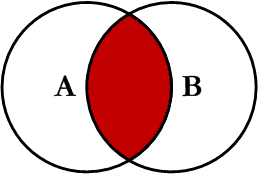

内连接 INNER JOIN

内连接:只有进行连接的两个表中都存在与连接条件相匹配的数据才会被保留下来。

案例实操:通过emp表和dept表查询员工编号、员工姓名、部门编号、部门名称。

1 | hive (default)> select |

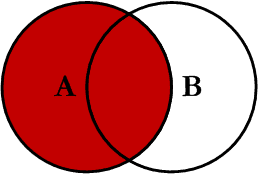

左外连接 LEFT JOIN

左外连接:JOIN操作符左边表中符合join子句的所有记录将会被返回。

案例实操:通过emp表和dept表查询员工编号、员工姓名、部门编号、部门名称。

1 | hive(default)> select |

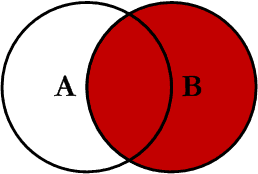

右外连接 RIGHT JOIN

右外连接:JOIN操作符右边表中符合join子句的所有记录将会被返回。

案例实操:通过emp表和dept表查询员工编号、员工姓名、部门编号、部门名称。

1 | hive (default)> select |

满外连接 OUTER JOIN

满外连接:将会返回所有表中符合WHERE语句条件的所有记录。

案例实操:通过emp表和dept表查询员工编号、员工姓名、部门编号、部门名称。

1 | hive (default)> select |

多表连接 OUTER EXCLUDING JOIN

注意:连接 n个表,至少需要n-1个连接条件。例如:连接三个表,至少需要两个连接条件。

-

数据准备:在/opt/module/hive/datas/ 下创建文件location.txt,内容如下:

1 | [root@hadoop datas]$ vim location.txt |

-

创建表location

1 | hive(default)> create table if not exists location( |

向location表中导入数据

1 | hive (default)> load data local inpath '/opt/module/hive/datas/location.txt' into table location; |

-

多表连接实操:查询每个员工姓名、部门名称及部门所在地。

1 | hive (default)> select |

-

join操作转换成MR:

大多数情况下,Hive会对每对JOIN连接对象启动一个MapReduce任务。

本例中会首先启动一个MapReduce job对表e和表d进行连接操作,

然后会再启动一个MapReduce job将第一个MapReduce job的输出和表l进行连接操作。

注意:为什么不是表d和表l先进行连接操作呢?这是因为Hive总是按照从左到右的顺序执行的。

笛卡尔积

笛卡尔积会在下面条件下产生:

省略连接条件

连接条件无效

所有表中的所有行互相连接

案例实操:hive (default)> select empno, dname from <font style="color:#DF2A3F;">emp, dept</font>;

排序

全局排序 ORDER BY

-

order by:全局排序,只有一个Reducer

-

顺序:ASC(ascend):升序(默认升序);DESC(descend):降序

-

位置:ORDER BY子句在SELECT语句的结尾

-

案例实操:

查询员工信息按工资升序排列

1 | hive (default)> select * from emp order by sal; |

查询员工信息按工资降序排列

1 | hive (default)> select * from emp order by sal desc; |

按照员工薪水的2倍排序

1 | hive (default)> select ename, sal*2 twosal from emp order by twosal; |

按照部门和工资升序排序

1 | hive (default)> select ename, deptno, sal from emp order by deptno, sal ; |

使用order by 对数据排序时只有一个reduce,面对海量数据排序时,一个reduce 效率太低,并且大 多数场景下,并不需要全局排序。

每个REDUCE内部排序(SORT BY)

-

sort by:在每个 Reducer 内部进行排序,对全局结果集来说不是有序。sort by 为每个 reducer 产生一 个排序文件,每个Reducer内部进行排序,对全局结果来说不是排序。

-

通过命令设置reduce个数(Hive默认会根据数据量来设置reduce的个数,这里手动设置reduce个数)

1 | hive (default)> set mapreduce.job.reduces=3; |

-

案例实操:

根据部门编号降序查看员工信息

1 | hive (default)> select * from emp sort by deptno desc; |

将查询结果导入到文件中(按照部门编号降序排序)

1 | hive (default)> insert overwrite local directory '/opt/module/hive/datas/sortby-result' |

分区(DISTRIBUTE BY)

distribute by:在有些情况下,我们需要控制某个特定行应该到哪个reducer,通常时为了进行后续的聚集操作。 distribute by 可以实现。distribute by 类似 MR 中 partition(自定义分区),进行分区,结合 sort by 使用。对于distribute by 进行测试,一定要分配多reduce进行处理,否则无法看到distribute by的效果。

案例实操:先按照部门编号分区,再按照员工薪水降序排序。

1 | hive (default)> set mapreduce.job.reduces=3; |

注意:

-

distribute by 的分区规则是根据分区字段的hash 码与reduce 的个数进行模除后,余数相同的分到一起。

-

Hive 要求DISTRIBUTE BY 语句要写在SORT BY 语句之前。

-

测试完毕后,记得将mapreduce.job.reduces 的值恢复到-1,否则下面的分区和分桶测试就会报错。

CLUSTER BY

cluster by:

-

当distribute by 和sort by 字段相同时,可以使用cluster by方式。

-

cluster by 除了具有distribute by 的功能外还兼具sort by的功能。

-

但是排序只能是升序排序,不能指定排序规则为ASC或者DESC。

案例实操:查询emp表中的员工姓名、员工编号、部门编号、薪资,并按照部门编号分区排序。 以下两种写法等价

1 | hive (default)> select ename,empno,deptno,sal from emp cluster by deptno; |

注意:按照部门编号分区,不一定就是固定死的数值,可以是20号和30号部门分到一个分区里面。